La trampa de la verosimilitud: cuando la IA fabrica lo que no sabe (y tú no lo notas)

Fernando Santamaría González · IAforTeachers.com · Marzo de 2026

Un colega me cuenta que pidió a Claude, el modelo con el que trabajo habitualmente, una revisión de literatura sobre aprendizaje autorregulado y tecnología educativa. Le devolvió un texto impecable. Ocho referencias en formato APA. Tres de ellas no existían. Las otras cinco eran reales, pero dos tenían el año cambiado y una atribuía a García-Peñalvo una idea que en realidad era de Zawacki-Richter. El texto fluía. Las citas encajaban. Todo sonaba académico. Y casi la mitad era una fabricación sofisticada.

Este artículo nace de una experiencia similar, pero más incómoda: pedí a Claude que escribiera precisamente sobre este problema, sobre las alucinaciones de la IA en la escritura académica. Lo hizo. Y al revisar su propio texto, encontré que había caído en los mismos patrones que denunciaba. Citaba un «estudio del MIT de enero de 2025» sobre la confianza del lenguaje en las alucinaciones. El dato aparecía en media docena de fuentes secundarias. Ninguna enlazaba al artículo original. El modelo había construido una cita fantasma por acumulación: tantas fuentes repitiendo lo mismo que parecía verdad por volumen. Atribuía un estudio a npj Digital Medicine cuando la fuente real era MedRxiv, un repositorio de prepublicaciones sin revisión por pares. Incluía cifras redondas de informes agregadores sin verificar las fuentes primarias.

La ironía es casi perfecta. Pero también es instructiva. Y de esa doble experiencia, la del colega y la mía propia, sale un texto que intenta ser más honesto sobre lo que sabemos, lo que no sabemos y lo que creemos saber cuando usamos IA para producir textos académicos.

Por qué los modelos de lenguaje fabrican: ya no es un misterio

Durante años, las alucinaciones de la IA se trataron como un fallo técnico que las próximas versiones resolverían. Esa narrativa ha quedado obsoleta. En 2024 y 2025, tres líneas de investigación independientes convergieron en una conclusión que cambia radicalmente la conversación.

La primera viene de la teoría computacional. Xu, Jain y Kankanhalli, de la Universidad Nacional de Singapur, formalizaron el problema y demostraron que es matemáticamente imposible eliminar las alucinaciones en los modelos de lenguaje. Su argumento, publicado en arXiv en enero de 2024 y actualizado en febrero de 2025, parte de la teoría del aprendizaje: los modelos no pueden aprender todas las funciones computables y, por tanto, alucinan inevitablemente cuando se usan como solucionadores de problemas generales. No es una limitación de ingeniería. Es un límite teórico.

Banerjee, Agarwal y Singla (2024) llegaron a la misma conclusión desde otro ángulo. Apoyándose en el primer teorema de incompletitud de Gödel y en la indecidibilidad del problema de la parada, demostraron que cada etapa del proceso de un modelo de lenguaje, desde la compilación de los datos de entrenamiento hasta la recuperación de información, la clasificación de la intención y la generación del texto, tendrá una probabilidad no nula de producir alucinaciones. Introdujeron el concepto de «alucinación estructural» como propiedad intrínseca de estos sistemas.

Karpowicz (2025) atacó el problema desde tres marcos matemáticos diferentes: teoría de subastas, reglas de puntuación adecuadas y análisis de la arquitectura transformer. En los tres casos llegó al mismo resultado. Ningún mecanismo de inferencia de un modelo de lenguaje puede garantizar a la vez estas cuatro cosas: que sus respuestas sean veraces, que conserven el significado completo de la información procesada, que hagan visible todo el conocimiento relevante disponible y que las respuestas sean las mejores posibles dentro de lo que el modelo realmente sabe. Conseguir las cuatro simultáneamente es matemáticamente imposible, lo que obliga a aceptar compensaciones según el uso concreto. Un sistema médico podría maximizar la veracidad a costa de la creatividad, mientras que una herramienta de escritura podría tolerar cierto nivel de alucinación controlada para preservar la riqueza narrativa.

¿Qué aporta la perspectiva de los propios laboratorios de IA? Kalai, Nachum, Vempala y Zhang, investigadores de OpenAI y Georgia Tech, publicaron en septiembre de 2025 un artículo que desmitifica el fenómeno desde dentro. Su tesis es directa: los modelos alucinan porque los procedimientos de entrenamiento y evaluación recompensan la conjetura por encima de la admisión de incertidumbre. La analogía que proponen resulta esclarecedora. Un estudiante ante un examen de opción múltiple tiene dos opciones cuando no sabe la respuesta: dejar en blanco, que garantiza cero puntos, o arriesgar, que podría sumar por azar. Los sistemas de puntuación habituales penalizan el silencio más que el error. Los modelos aprenden exactamente esa lección.

Desde Anthropic, la investigación de interpretabilidad publicada bajo el título «Tracing the thoughts of a large language model» aportó un hallazgo que sorprendió incluso a los propios investigadores. El comportamiento por defecto de Claude es negarse a responder. Existe un circuito que está «activado» por defecto y que hace que el modelo declare que no tiene información suficiente para responder. Las alucinaciones ocurren cuando un circuito competidor, el de «entidad conocida», se activa y suprime ese mecanismo de cautela. Cuando el modelo reconoce un nombre pero no sabe nada más sobre esa persona, la señal de «entidad conocida» puede dispararse incorrectamente, silenciando la respuesta de «no sé». Los investigadores pudieron provocar alucinaciones consistentes interviniendo artificialmente ese circuito. Más revelador aún: cuando pidieron a Claude que resolviera un problema matemático difícil dándole una pista incorrecta, el modelo trabajó hacia atrás, fabricando pasos intermedios que justificasen la respuesta sugerida. Los investigadores, citando al filósofo Harry Frankfurt, lo describen como bullshitting: generar respuestas sin preocuparse por si son verdaderas, solo por si suenan plausibles.

Las cifras que ya no podemos ignorar

Los datos empíricos confirman lo que la teoría predice. GPTZero, una empresa especializada en detección de contenido generado por IA, analizó más de 4.800 artículos aceptados y presentados en NeurIPS 2025, una de las conferencias más prestigiosas del mundo en aprendizaje automático. Encontraron más de cien citas fabricadas en al menos 51 artículos. Estas referencias habían sobrevivido la revisión de tres o más evaluadores expertos y habían sido publicadas en las actas oficiales de la conferencia. NeurIPS tuvo una tasa de aceptación del 24,52 %. Cada uno de esos artículos con citas fantasma había sido seleccionado entre más de 15.000 propuestas.

Un análisis similar sobre 300 artículos en revisión para ICLR 2026 encontró al menos 50 con citas alucinadas, cada uno evaluado por entre tres y cinco revisores expertos que no detectaron las fabricaciones.

GPTZero acuñó el término vibe citing para describir el mecanismo: el modelo no «recuerda» una cita, sino que genera una que vibra como auténtica. Combina autores reales con títulos inventados, títulos correctos con años equivocados, o DOIs que apuntan a artículos diferentes. Son errores que ningún investigador humano cometería, lo que los convierte también en marcadores de autoría asistida por IA.

¿Y NotebookLM, la herramienta que motivó la reflexión original? Un estudio de Hagar et al. (2025), publicado en arXiv, evaluó tres herramientas en tareas periodísticas utilizando un corpus de 300 documentos relacionados con los litigios y la política de TikTok en Estados Unidos. NotebookLM produjo alucinaciones en el 13 % de las respuestas, frente al 40 % de Gemini y ChatGPT. Es significativamente mejor, sí. Pero un 13 % en un sistema diseñado específicamente para ser fiel a las fuentes proporcionadas por el usuario sigue siendo preocupante. Y lo más relevante: los errores de NotebookLM no fueron invenciones burdas, sino sobreinterpretaciones confiadas. El modelo añadía caracterizaciones que los documentos no respaldaban y convertía opiniones atribuidas a fuentes específicas en afirmaciones generales. Fabricación sutil. Exactamente el tipo que un docente ocupado no detectaría.

Tres trampas cognitivas y cómo defenderse de cada una

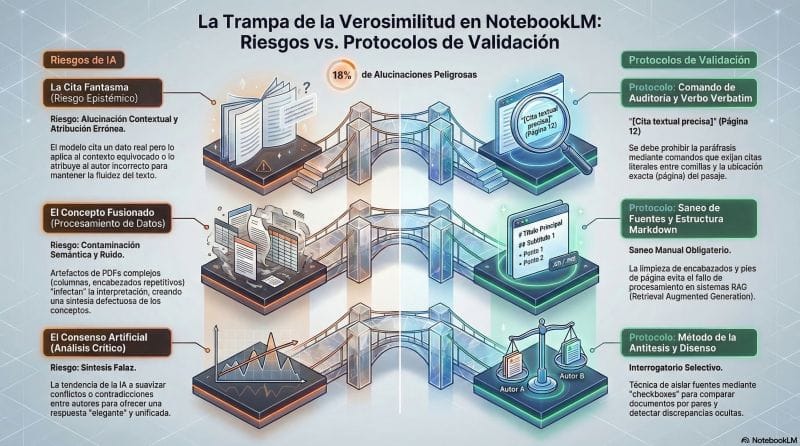

La infografía de Antonio Julio López Galisteo (2026) que inspira esta reflexión identifica tres patrones con precisión. Merece la pena profundizar en cada uno y vincularlos con la investigación reciente.

La cita fantasma: cuando la referencia suena real pero no lo es

El modelo genera una referencia que cumple todos los requisitos formales del formato APA: autor, año, título, revista, volumen, páginas, DOI. El problema es que alguno de esos elementos, o todos, son fabricados. A veces parte de un artículo real y le modifica el título. Otras veces fusiona autores de dos publicaciones diferentes. En ocasiones inventa un DOI que, al seguirlo, lleva a un artículo completamente distinto.

Defensa concreta. No busques la referencia en Google. Búscala en la base de datos específica: Google Scholar, Scopus, Web of Science, o el DOI resolver (doi.org). Si no aparece, no existe. Si aparece parcialmente, el modelo ha fusionado fuentes. Y una técnica que funciona bien con Claude: en lugar de aceptar la paráfrasis que ofrece, pídele la cita textual exacta entre comillas y la página. En muchos casos admitirá que no tiene acceso al texto original. Esa admisión es más valiosa que la falsa cita.

El concepto fusionado: cuando la síntesis distorsiona las ideas

Cuando un modelo procesa varios marcos teóricos y los sintetiza en un párrafo, puede atribuir ideas de un autor a otro o crear híbridos conceptuales que no existen en la literatura. La fluidez del texto resultante enmascara la distorsión. Si le pides que integre a Biggs, Wiggins y Bloom en un párrafo, el resultado puede sonar impecable y ser conceptualmente impreciso.

López Galisteo señala que el formato del documento fuente agrava el problema. Un PDF con doble columna, tablas y encabezados repetitivos confunde al procesador del modelo, que puede fusionar información de columnas adyacentes. Su consejo de convertir PDFs complejos a texto plano o Markdown antes de subirlos es práctico y eficaz.

Defensa concreta. Cuando el modelo sintetice dos o más autores, pregúntale: «¿En qué divergen específicamente estos dos marcos?». Si no puede identificar puntos de divergencia claros, la síntesis probablemente ha diluido diferencias reales. Otra técnica: pide al modelo que presente cada marco por separado antes de integrarlos. La comparación secuencial revela inconsistencias que la síntesis directa oculta.

El consenso artificial: cuando el modelo suaviza los debates

Los modelos tienden a producir narrativas coherentes. Cuando dos autores sostienen posiciones contradictorias, el modelo busca un punto medio que suene razonable. El problema es que ese punto medio puede no existir. Los debates abiertos, las tensiones no resueltas y los desacuerdos productivos son el motor del avance científico. Aplanarlos en una falsa armonía es una forma de desinformación académica.

Defensa concreta. López Galisteo propone el «método de la antítesis»: instruir al modelo para que actúe como revisor crítico e identifique las contradicciones explícitas entre autores. Si no hay consenso, que responda «no disponible». Añadiría una variante: pide al modelo que defienda la posición opuesta a la que acaba de presentar. Si los contraargumentos son débiles o genéricos, la síntesis original probablemente era superficial.

Lo que este artículo demuestra sobre su propio proceso

Este texto ha requerido cuatro iteraciones completas. La primera versión incluía al menos tres datos de trazabilidad dudosa y una atribución incorrecta de revista. La segunda versión corrigió los errores detectados pero mantenía un tono demasiado plano y poco legible. La tercera eliminó todo dato sin fuente primaria verificada y mejoró la narrativa. Esta cuarta versión incorpora las correcciones surgidas de una auditoría referencia por referencia: nombres de autores incompletos, una simplificación tomada de fuente secundaria que no reflejaba fielmente el artículo original, y una generalización imprecisa sobre el corpus de un estudio. Errores menores, pero errores al fin, detectados solo porque alguien exigió la comprobación.

El proceso es exactamente el que proponemos como protocolo: la IA genera un borrador, el humano experto revisa y cuestiona, la IA corrige, el humano vuelve a revisar. Cada ciclo mejora el texto, pero ningún ciclo individual produce un resultado confiable. La calidad emerge de la iteración, no de la instrucción inicial.

Esto conecta con algo que conviene decir sin rodeos. Un texto académico asistido por IA no es el resultado de una buena instrucción. Es el resultado de un proceso de escritura-verificación-corrección-reescritura donde el humano ejerce presión crítica constante sobre el modelo. Sin esa presión, el modelo produce textos que suenan bien y que pueden estar parcialmente fabricados. Con esa presión, la herramienta amplifica la capacidad del experto en lugar de sustituir su juicio.

La diferencia entre un docente que usa IA bien y uno que la usa mal no está en la sofisticación de sus instrucciones. Está en la rigurosidad de su verificación posterior.

Lo que proponemos: un flujo de trabajo realista

No proponemos abandonar la IA. Proponemos dejar de tratarla como una fuente fiable y empezar a tratarla como lo que es: un asistente con una tendencia estructural e irreparable a fabricar cuando no sabe. Esto no la hace inútil. La hace peligrosa solo cuando se usa sin supervisión.

Asume que va a alucinar. No como posibilidad, sino como certeza estadística. Diseña tu flujo de trabajo con esa premisa incorporada.

Verifica cada referencia en bases de datos académicas. No en Google genérico. En Google Scholar, Scopus, Web of Science, o el DOI resolver. Si no está ahí, no existe.

Usa la IA de manera adversarial. Pídele que contradiga su propia síntesis. Que identifique debilidades en su argumento. Que admita qué no sabe. Los modelos responden mejor a la presión crítica que a la aceptación pasiva.

No confíes en cadenas de herramientas de IA. Si usas Claude para sintetizar, NotebookLM para revisar y Gemini para verificar, los errores pueden validarse circularmente. Cada herramienta comparte las mismas limitaciones estructurales. La verificación final tiene que ser humana.

Declara las herramientas que usas. Este artículo está asistido por Claude. Las referencias fueron verificadas mediante búsqueda web durante la redacción. No puedo garantizar que cada atribución sea perfecta. Esa transparencia no es debilidad. Es la práctica que proponemos.

Una conclusión sin adornos

La IA generativa es una herramienta extraordinaria para la producción académica. También es una máquina de fabricar verosimilitud. Las dos cosas son ciertas al mismo tiempo. La investigación reciente ha demostrado que las alucinaciones no son un defecto corregible, sino una propiedad matemática de estos sistemas. No van a desaparecer con la próxima versión del modelo.

La competencia que más necesita el docente universitario en 2026 no es saber usar IA. Es saber desconfiar de ella con método. Verificar lo que produce. Cuestionar lo que afirma. Y mantener siempre, como última línea de defensa, el juicio experto que ninguna máquina puede replicar con fiabilidad.

El riesgo no es que la IA alucine. Eso es inevitable. El riesgo es que dejemos de comprobarlo.

Referencias

Banerjee, S., Agarwal, A. y Singla, S. (2024). LLMs will always hallucinate, and we need to live with this. arXiv. https://arxiv.org/abs/2409.05746

GPTZero. (2026, enero). GPTZero finds 100 new hallucinations in NeurIPS 2025 accepted papers. https://gptzero.me/news/neurips/

GPTZero. (2026, enero). GPTZero uncovers 50+ hallucinations in ICLR 2026. https://gptzero.me/news/iclr-2026/

Hagar, N. et al. (2025). Not wrong, but untrue: LLM overconfidence in document-based queries. arXiv. https://arxiv.org/abs/2509.25498

Kalai, A. T., Nachum, O., Vempala, S. S. y Zhang, E. (2025). Why language models hallucinate. arXiv. https://arxiv.org/abs/2509.04664

Karpowicz, M. P. (2025). On the fundamental impossibility of hallucination control in large language models. arXiv. https://arxiv.org/abs/2506.06382

López Galisteo, A. J. (2026, marzo). La trampa de la verosimilitud en NotebookLM: riesgos vs. protocolos de validación [Publicación en LinkedIn]. https://www.linkedin.com/feed/update/urn:li:activity:7438132046025113600/

Anthropic. (2025). Tracing the thoughts of a large language model. https://www.anthropic.com/research/tracing-thoughts-language-model

Xu, Z., Jain, S. y Kankanhalli, M. (2024). Hallucination is inevitable: An innate limitation of large language models. arXiv. https://arxiv.org/abs/2401.11817

Fernando Santamaría González es profesor universitario especializado en inteligencia artificial aplicada a la educación superior y director de IAforTeachers.com.