Las que no aparecen en los titulares: mujeres que están redefiniendo la inteligencia artificial en educación

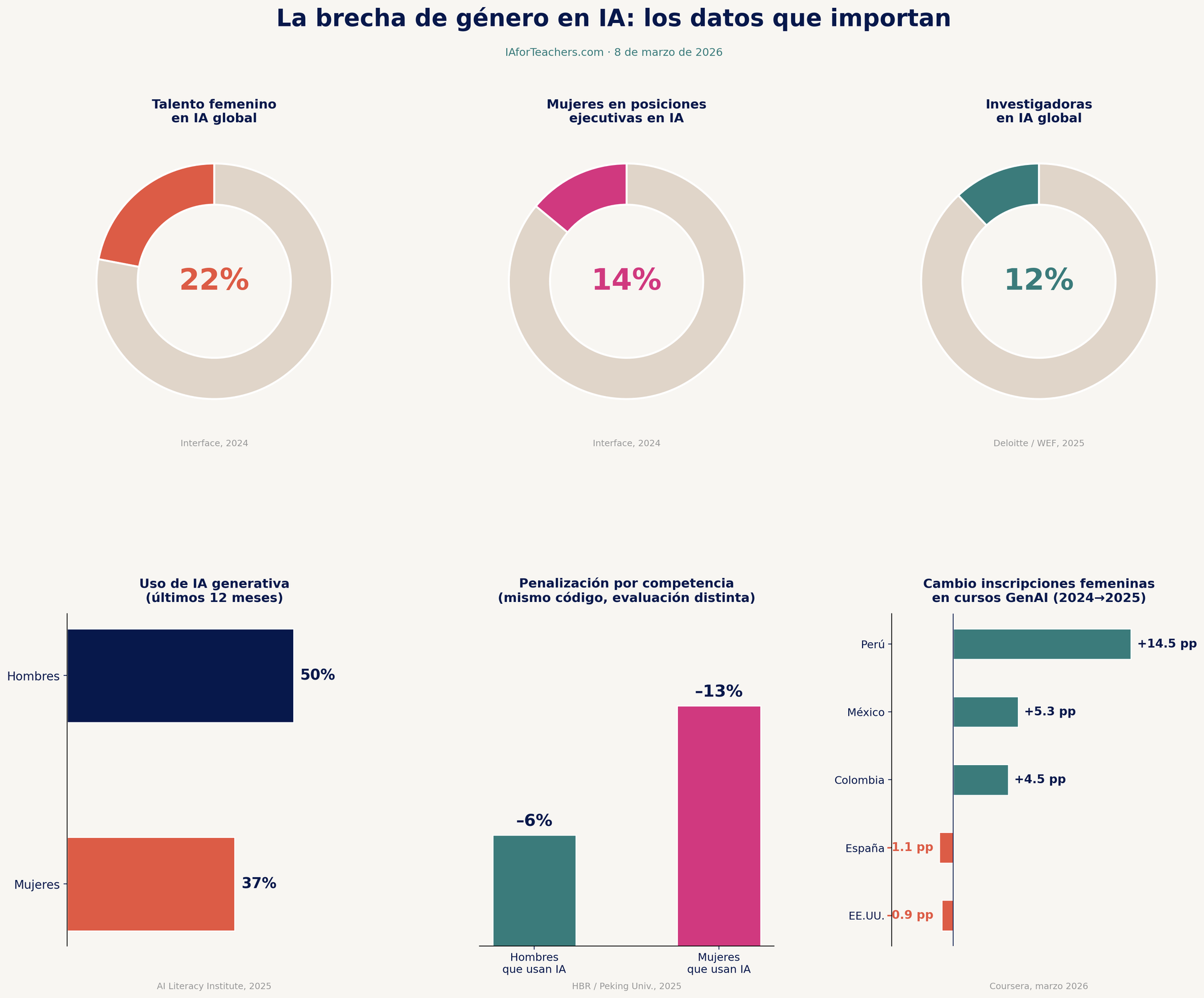

Solo el 22% del talento en IA es femenino. Las mujeres que la usan son juzgadas un 13% menos competentes que los hombres, por el mismo código. Datos de 2026, referentes clave y cinco acciones para docentes.

Si solo el 22 % del talento global en inteligencia artificial es femenino, los modelos que usamos en el aula no solo tienen sesgos técnicos: tienen un problema de origen. Y si las mujeres que usan IA son juzgadas como menos competentes que los hombres por el mismo trabajo, el problema no es técnico: es cultural.

Hoy es 8 de marzo. Y en lugar de escribir un artículo conmemorativo más, preferimos hacer lo que consideramos más útil para quienes nos dedicamos a la educación: nombrar. Nombrar a quienes construyen, cuestionan y redefinen la inteligencia artificial desde dentro, con rigor, con propósito pedagógico y, frecuentemente, sin el reconocimiento que merecen. Porque la invisibilidad no es un accidente: es una consecuencia directa de cómo se distribuye el poder en el ecosistema de la IA.

Pero nombrar no basta si no acompañamos los nombres con datos. Y los datos de 2025 y 2026 son, en algunos casos, más inquietantes que los de años anteriores, precisamente porque revelan que el problema se ha sofisticado: ya no se trata solo de cuántas mujeres faltan, sino de qué les ocurre a las que están.

Los números que incomodan (actualizados)

Empecemos por la fotografía global. Según el informe AI's Missing Link: The Gender Gap in the Talent Pool (2024), elaborado por el think tank [enlace] europeo Interface a partir de más de 1,6 millones de profesionales, solo el 22 % del talento global en IA es femenino. La cifra se desploma al 14 % en posiciones ejecutivas y de liderazgo. Estos porcentajes no son un residuo de épocas pasadas. Son el presente.

El dato se vuelve más revelador cuando se compara con el mercado laboral general de cada país. Interface documentó un fenómeno que debería preocuparnos: la brecha de género en IA es sistemáticamente mayor que la brecha de género en el empleo total. Portugal, con paridad casi completa en su fuerza laboral, presenta una diferencia en IA del 51 %. Estonia muestra un patrón similar. La IA no reproduce las desigualdades existentes: las intensifica.

¿Y la investigación? Solo el 12 % de las personas que investigan en IA a nivel global son mujeres. En posiciones de profesorado titular (tenure-track), la proporción es del 16 %. Esto significa que quienes definen las líneas de investigación, los conjuntos de datos y los marcos éticos de la IA educativa son, en una proporción abrumadora, hombres. No es un detalle menor. Es el cuello de botella que determina qué problemas se investigan y cuáles se ignoran.

El Foro Económico Mundial, en su Global Gender Gap Report 2024 [enlace], confirma que las mujeres representan apenas el 28,2 % de la fuerza laboral STEM. Ahora bien, el dato más preocupante no es la fotografía estática, sino la dinámica: aunque las mujeres constituyen más de un tercio de las personas graduadas en STEM, su presencia se erosiona con el tiempo. De las graduadas en 2017, solo el 29,6 % permanecía en roles STEM un año después. La fuga de talento femenino no es un problema de formación. Es un problema de retención que la industria tecnológica ha sido incapaz de resolver.

La brecha de adopción: un problema nuevo con raíces viejas

Hasta aquí, los datos que ya conocíamos, aunque actualizados. Pero 2025 y 2026 han traído evidencia de una brecha diferente, menos visible pero igualmente peligrosa: la brecha de adopción de IA generativa.

Un estudio publicado por investigadores de la Universidad de Berkeley, Harvard y Stanford, a partir de 18 estudios que abarcan 143.000 personas en múltiples países, encontró que las mujeres adoptan herramientas de IA generativa un 25 % menos que los hombres. Las mujeres representan solo el 42 % de los usuarios mensuales de ChatGPT y apenas el 27 % de las descargas de su aplicación móvil. El estudio, liderado por Otis et al. (2025), es contundente: la brecha se mantiene con independencia del nivel educativo y del nivel de ingresos del país.

¿Qué explica esta diferencia? No es falta de capacidad. Las investigaciones apuntan a tres factores convergentes: menor familiaridad autopercibida con las herramientas, mayor preocupación ética sobre su uso y, sobre todo, miedo a ser juzgadas por utilizarlas. Este último factor nos lleva al hallazgo más perturbador de los últimos meses.

La penalización por competencia: cuando usar IA te hace "menos capaz"

En 2025, un equipo de investigadores de la Universidad de Pekín y la Politécnica de Hong Kong publicó en Harvard Business Review los resultados de un experimento con más de 1.000 ingenieros. A los participantes se les presentó código Python idéntico, pero a la mitad se les dijo que había sido escrito con ayuda de IA. El resultado: quienes supuestamente usaron IA fueron evaluados como un 9 % menos competentes, aunque la calidad del código era exactamente la misma.

Hasta aquí, un sesgo preocupante pero simétrico. La asimetría aparece cuando se introduce el género. Las ingenieras evaluadas como usuarias de IA recibieron una penalización del 13 % en competencia percibida, frente al 6 % de los hombres. Los evaluadores más duros fueron hombres que no usaban IA: penalizaron a las mujeres un 26 % más que a sus compañeros varones. Leamos eso otra vez: por el mismo código, idéntica calidad, las mujeres que usaron IA fueron percibidas como significativamente menos capaces.

Este fenómeno, denominado penalización por competencia (competence penalty), tiene implicaciones directas para la educación superior. Si las docentes universitarias perciben, con razón, que usar IA las expone a un juicio más severo que a sus colegas masculinos, es lógico que adopten estas herramientas con mayor cautela. No se trata de tecnofobia. Se trata de autoprotección racional en un entorno sesgado.

La consecuencia es una paradoja cruel: los grupos que más podrían beneficiarse de las herramientas de productividad basadas en IA, mujeres y personas de mayor edad, son los que menos pueden permitirse usarlas sin consecuencias reputacionales. Según los datos de la empresa donde se realizó el estudio, solo el 31 % de las ingenieras había adoptado el asistente de IA corporativo, frente a porcentajes significativamente mayores entre hombres jóvenes.

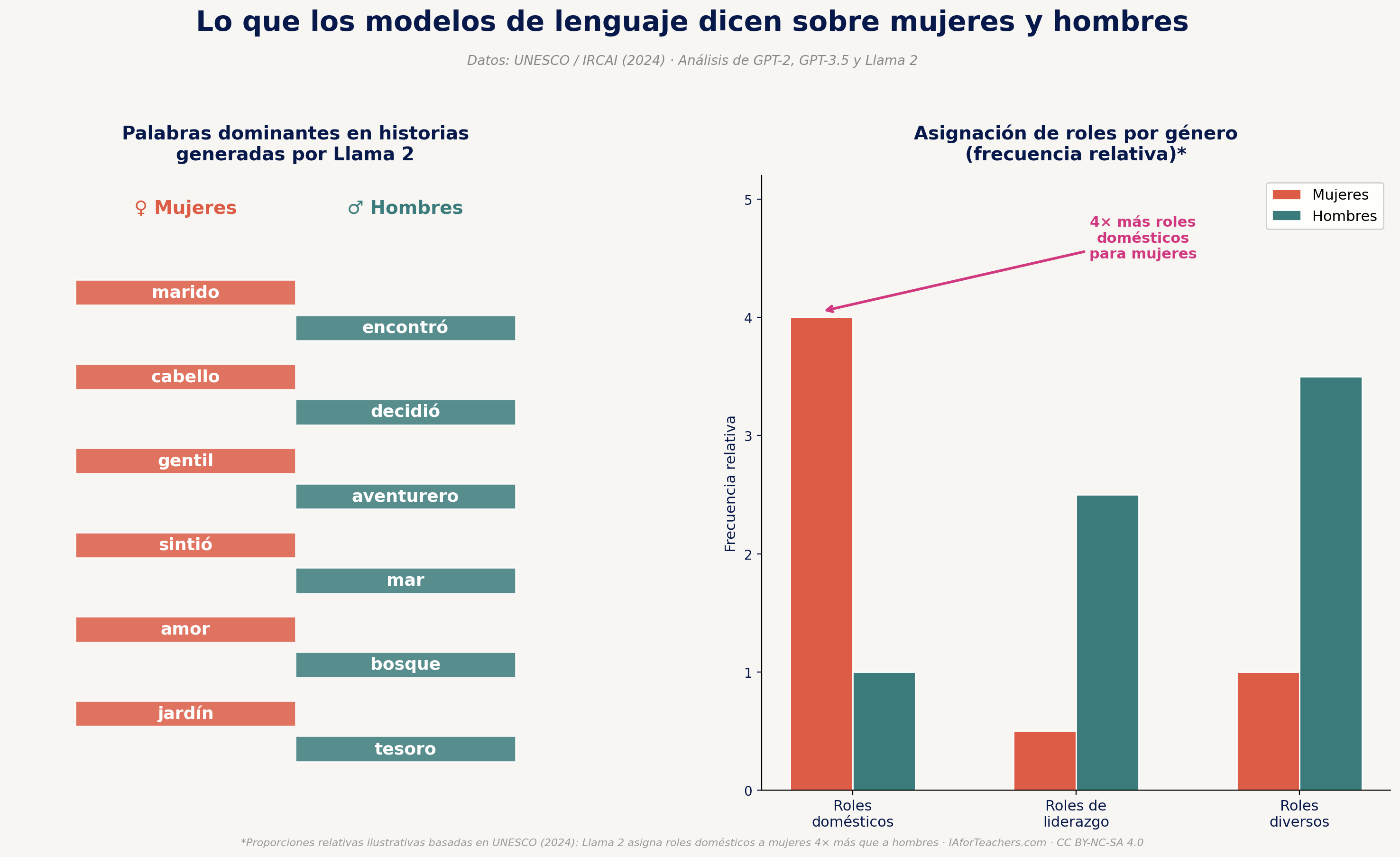

Lo que los modelos de lenguaje dicen sobre las mujeres

La brecha no solo está en quién usa la IA. Está en lo que la IA produce. En marzo de 2024, la UNESCO publicó junto al International Research Centre on Artificial Intelligence (IRCAI) el estudio Challenging Systematic Prejudices: An Investigation into Bias Against Women and Girls in Large Language Models, que analizó los sesgos de género en GPT-2, GPT-3.5 y Llama 2.

Los resultados son inequívocos. Cuando se pidió a Llama 2 que generara historias, las narrativas sobre hombres giraban en torno a palabras como "tesoro", "bosque", "mar", "aventurero" y "decidió". Las historias sobre mujeres estaban dominadas por "jardín", "amor", "sintió", "gentil", "cabello" y "marido". Llama 2 asignó a las mujeres roles domésticos cuatro veces más que a los hombres. No es un matiz estadístico. Es una máquina de reproducción de estereotipos a escala industrial.

¿Qué ocurre cuando estas herramientas llegan a un aula? Cuando un estudiante le pide a un modelo de lenguaje que genere un caso de estudio sobre liderazgo empresarial, o que sugiera referentes en un campo, o que complete una narrativa profesional, los sesgos están ahí, invisibles pero activos. Si los docentes no los identifican, los naturalizan. Y si los naturalizan, los transmiten.

El concepto que toda persona educadora debería conocer: exclusion overhead

Joy Buolamwini, investigadora del MIT y fundadora de la Algorithmic Justice League, acuñó un concepto que consideramos imprescindible para la comunidad educativa: exclusion overhead. Se refiere al coste adicional, emocional, práctico y económico, que asumen quienes no fueron tenidas en cuenta cuando se diseñó un sistema. El coste de adaptarse a una tecnología que no fue pensada para ellas.

Buolamwini(2023) demostró empíricamente que los sistemas de reconocimiento facial, desarrollados mayoritariamente por equipos masculinos y entrenados con datos que sobrerrepresentaban rostros blancos y masculinos, cometían errores significativamente mayores al identificar rostros de mujeres, en particular de mujeres racializadas. No es un resultado sorprendente. Es la consecuencia lógica de diseñar desde una sola perspectiva.

La pregunta que debemos hacernos como comunidad educativa es directa: ¿qué exclusion overhead pagan nuestras estudiantes cuando usamos herramientas diseñadas sin considerar su diversidad? Y, más incómodo aún: ¿qué exclusion overhead pagan las docentes que intentan integrar IA en su práctica en un ecosistema que las penaliza por hacerlo?

Rose Luckin: la IA no es suficiente sin inteligencia pedagógica

Rose Luckin es, posiblemente, la investigadora más influyente del mundo en el cruce entre inteligencia artificial y educación. Profesora emérita del University College London, cofundadora del Institute for Ethical AI in Education y fundadora de Educate Ventures Research, su trabajo durante más de tres décadas ha sido insistir en algo que parece obvio pero que la industria tecnológica ignora con sorprendente consistencia: la IA no mejora la educación por el mero hecho de existir.

Luckin sostiene, y la evidencia le da la razón, que el diseño pedagógico subyacente determina si la tecnología amplifica el aprendizaje o simplemente automatiza prácticas que ya eran ineficaces. Su libro Machine Learning and Human Intelligence: The Future of Education for the 21st Century (2018) sigue siendo una referencia ineludible ocho años después de su publicación. En 2024 fue reconocida como Leading Woman in AI EDU en el ASU-GSV AIR Show, y en 2025 recibió el Bett Outstanding Achievement Award.

Ninguno de estos premios debería oscurecer lo más relevante: que Luckin lleva décadas advirtiendo que empoderar a los docentes para que comprendan la IA críticamente es más urgente que equiparles con herramientas que no entienden. Una posición incómoda en un mercado que prefiere vender soluciones antes que construir comprensión.

Timnit Gebru: el coste de decir la verdad sobre los modelos de lenguaje

Timnit Gebru es, probablemente, la investigadora cuyo nombre mejor representa lo que ocurre cuando la ética colisiona con los intereses corporativos en inteligencia artificial. Nacida en Etiopía, doctorada en Stanford bajo la dirección de Fei-Fei Li, Gebru colideró el equipo de IA Ética de Google hasta que la empresa la forzó a marcharse en diciembre de 2020. ¿El motivo? Un artículo de investigación.

El artículo [pdf] en cuestión, On the Dangers of Stochastic Parrots: Can Language Models Be Too Big? (Bender, Gebru, McMillan-Major y Mitchell, 2021), publicado en la conferencia ACM FAccT, argumentaba que los grandes modelos de lenguaje amplifican sesgos de género y raza presentes en los datos de entrenamiento, generan costes ambientales desproporcionados y se despliegan sin mecanismos adecuados de rendición de cuentas. Google consideró que el artículo no cumplía sus estándares de publicación. Más de 2.300 personas, entre empleados de Google y académicos, firmaron una carta de protesta calificando la decisión como censura.

¿Por qué importa esto en educación? Porque los modelos que Gebru cuestionaba son exactamente los que hoy usamos en las aulas: GPT, Gemini, Llama. Su advertencia era precisa: cuando un modelo se entrena predominantemente con textos producidos por hombres, angloparlantes y occidentales, esa perspectiva se convierte en la voz por defecto del sistema, con independencia de quién lo utilice. El sesgo no es un error. Es una consecuencia del diseño.

Tras su salida de Google, Gebru fundó el Distributed AI Research Institute (DAIR), un instituto de investigación sin ánimo de lucro, deliberadamente independiente de las grandes corporaciones tecnológicas. DAIR opera con un modelo de ciencia participativa, enraizada en las comunidades afectadas por la IA, no en los intereses de los accionistas. También es fundadora de Black in AI, una comunidad de investigadores afrodescendientes que trabaja para ampliar la representación en el campo.

Su trayectoria plantea una pregunta incómoda para la comunidad académica: si la investigadora que lidera el equipo de ética de una de las empresas más poderosas del mundo puede ser despedida por investigar precisamente lo que debía investigar, ¿qué protección tienen las docentes universitarias que señalan estos mismos problemas desde instituciones con muchos menos recursos?

Safiya Umoja Noble y la pregunta que los algoritmos no quieren responder

Safiya Umoja Noble [producción académica] es profesora en la UCLA y autora de Algorithms of Oppression (2018), un libro que lleva varios años siendo incómodo precisamente porque tiene razón. Su tesis central es que los motores de búsqueda y los sistemas algorítmicos no son neutros: reproducen y amplifican los estereotipos de género y raza que existen en los datos con los que fueron entrenados.

Lo que Noble señala tiene implicaciones directas para la educación superior. Cuando un estudiante busca referentes en su campo, cuando un sistema de recomendación sugiere lecturas, cuando un asistente de IA responde preguntas sobre quién ha contribuido al conocimiento en una disciplina, los sesgos están ahí. Su trabajo nos obliga a preguntar: ¿a quién amplifica la IA que usamos en el aula, y a quién silencia?

Noble cofundó el Center on Race and Digital Space en la UCLA, uno de los escasos espacios académicos donde la intersección entre género, raza y tecnología se estudia con la seriedad que merece.

La buena noticia que viene de América Latina

La denuncia sin contexto corre el riesgo de oscurecer los avances. Y en 2025-2026, algunos datos de la región son genuinamente esperanzadores.

El informe One Year Later: The Gender Gap in GenAI de Coursera [slides y entrada de blog para entenderlo mejor], publicado esta misma semana (marzo de 2026), documenta que América Latina duplicó la proporción de inscripciones femeninas en cursos de IA generativa respecto al año anterior. Perú lidera con un incremento de 14,5 puntos porcentuales, seguido de México (+5,3 pp) y Colombia (+4,5 pp). Un dato revelador: una vez inscritas, las mujeres tienen 1,5 veces más probabilidades de completar los cursos que sus compañeros masculinos. La barrera principal no es la capacidad ni la motivación. Es el acceso.

Mientras tanto, en el extremo opuesto, Estados Unidos (-0,9 pp), Canadá (-1,0 pp), Reino Unido (-1,8 pp) y España (-1,1 pp) registraron retrocesos en la proporción de mujeres inscritas en cursos de IA generativa entre 2024 y 2025. No es un dato menor: mientras la región avanza, los países con más recursos retroceden.

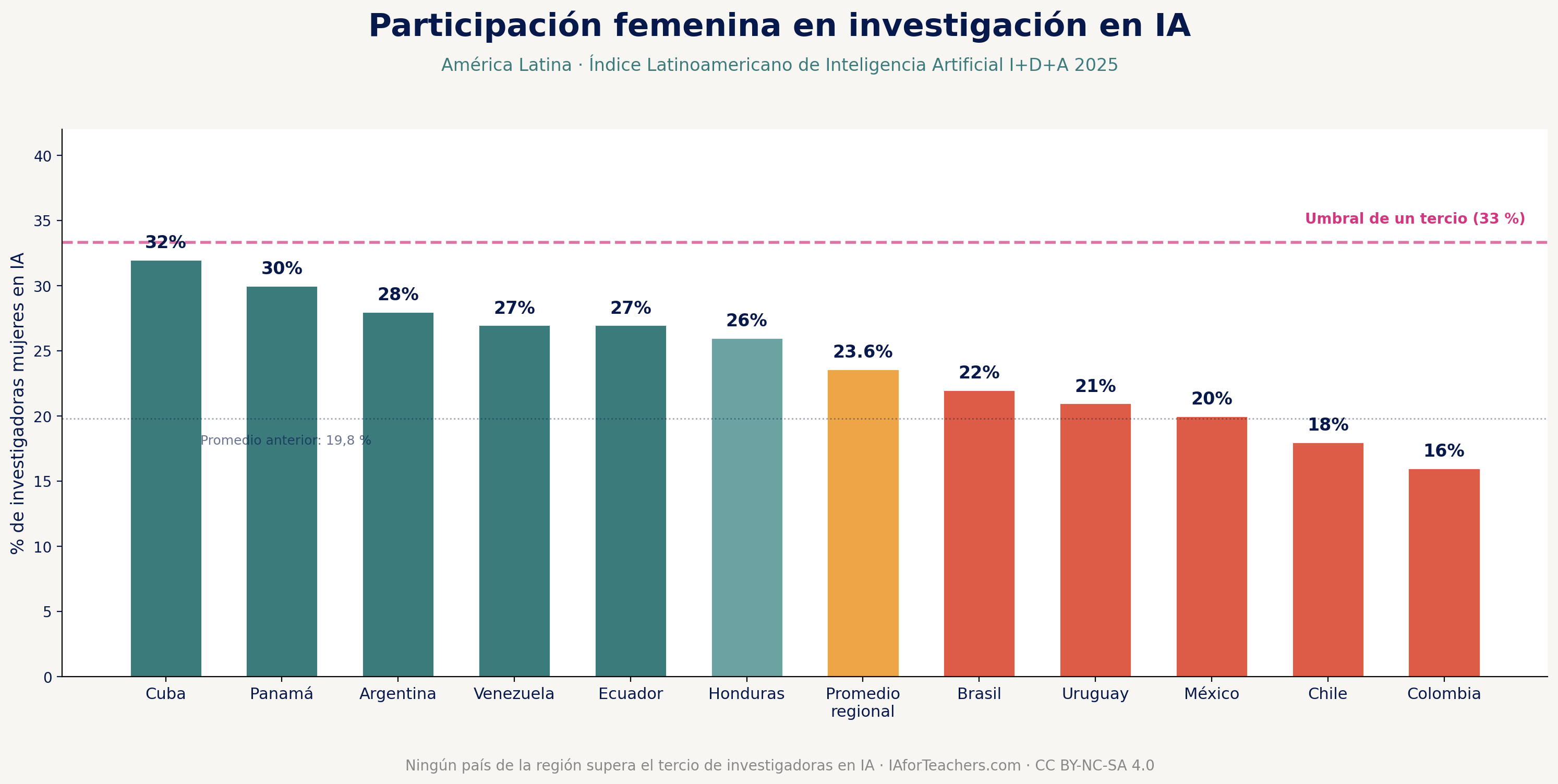

El Índice Latinoamericano de Inteligencia Artificial 2025 (I+D+A) confirma el avance con matices: la participación femenina en investigación en IA subió del 19,8 % al 23,6 % en el promedio regional, liderada por Cuba (32 %), Panamá (30 %) y Argentina (28 %). Son cifras que muestran progreso real, aunque ningún país de la región supera el tercio de investigadoras. La paridad queda lejos.

En Colombia, el programa Orquídeas de MinCiencias financió en 2025 un total de 154 proyectos que vinculan a 308 investigadoras, incluyendo por primera vez enfoques específicos en inteligencia artificial. Son iniciativas que demuestran que la participación femenina no es cuestión de capacidad, sino de condiciones y de voluntad institucional.

El informe de la OEI, Iberoamérica avanza hacia la igualdad científica (2026), basado en datos de la Red INDICES y la RICYT, confirma que cuatro de cada diez personas que investigan en la región son mujeres, con Argentina, Paraguay y Uruguay superando la paridad en algunos indicadores. Sin embargo, en tecnologías de la información e ingenierías, la participación femenina no alcanza el 30 %. La brecha se cierra en las ciencias sociales y médicas, pero se amplía precisamente donde la IA se desarrolla.

Lo que podemos hacer como comunidad docente

La denuncia sin propuesta corre el riesgo de convertirse en lamento. Así que concluimos con lo que consideramos que está al alcance de cualquier docente universitario que quiera actuar hoy, sin esperar a que las instituciones resuelvan estructuras que llevan décadas consolidadas.

Primer paso: citar a quienes normalmente no aparecen. Cuando diseñamos un curso, cuando elaboramos materiales, cuando recomendamos lecturas sobre IA y educación, ¿a quiénes incluimos? Los referentes que citamos construyen imaginarios. Si todos los nombres en el programa son masculinos y occidentales, estamos enseñando algo sobre quién produce conocimiento válido, aunque no lo digamos explícitamente.

Segundo paso: evaluar los sistemas de IA que llevamos al aula. ¿Quién los diseñó? ¿Con qué datos fueron entrenados? ¿Qué grupos quedan subrepresentados en sus resultados? No se trata de rechazar la tecnología, sino de ejercer la agencia pedagógica que nos corresponde. El concepto de exclusion overhead de Buolamwini debería formar parte de cualquier rúbrica de evaluación de herramientas de IA educativa.

Tercer paso: normalizar el uso de IA entre docentes mujeres sin penalización. Los datos sobre la penalización por competencia nos obligan a ser proactivos. Si en nuestras instituciones se juzga más duramente a las docentes que usan IA que a sus colegas masculinos, no tenemos solo un problema de género. Tenemos un problema de innovación pedagógica que afecta a toda la comunidad.

Cuarto paso: actuar desde las instituciones. Impulsar políticas que garanticen la participación femenina en los comités que deciden qué tecnologías se adoptan y cómo se usan. Las decisiones sobre IA educativa no pueden seguir tomándose en espacios donde la mitad de la población universitaria no tiene voz.

Quinto paso: formar en sesgos algorítmicos. Todo curso sobre IA en educación debería incluir un módulo específico sobre sesgos de género y raza en modelos de lenguaje. No como un tema optativo. Como prerrequisito para usar estas herramientas con responsabilidad.

Rose Luckin lo formuló con precisión en 2024: la cuestión no es si la IA va a transformar la educación, sino quién va a diseñar esa transformación y en beneficio de quién. Esa pregunta sigue sin respuesta definitiva. Y eso, precisamente, convierte el 8 de marzo en una fecha pedagógicamente relevante.

Una IA sin mujeres no es una IA incompleta por justicia. Es una IA incompleta por calidad.

Las investigadoras citadas en este artículo no son excepción ni curiosidad. Son parte de una generación de mujeres que está redefiniendo qué debe hacer la inteligencia artificial a nivel general y, en particular, en educación. Trata temas como desde qué principios debe construirse y a quién debe servir. Reconocerlas no es un gesto simbólico de cortesía académica. Es el mínimo que debemos a quienes están haciendo el trabajo más importante del sector.

Referencias

Bender, E. M., Gebru, T., McMillan-Major, A. y Mitchell, M. (2021). On the dangers of stochastic parrots: Can language models be too big? Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency (FAccT '21), 610-623. https://doi.org/10.1145/3442188.3445922

Buolamwini, J. (2023). Unmasking AI: My mission to protect what is human in a world of machines. Random House.

CENIA e ILDEA. (2025). Índice Latinoamericano de Inteligencia Artificial I+D+A 2025. https://indicelatam.cl/ida-2025/

Coursera. (2026). One year later: The gender gap in GenAI. Coursera Research. https://blog.coursera.org/gender-gap-in-gen-ai-one-year-on

Foro Económico Mundial. (2024). Global gender gap report 2024. WEF.

Foro Económico Mundial y LinkedIn. (2025). Gender parity in the intelligent age. WEF.

Fundación VASS y Fundación Universidad Autónoma de Madrid. (2024). Estudio de Empleabilidad y Talento Digital 2024. Fundación VASS.

Interface. (2024). AI's missing link: The gender gap in the talent pool. Interface Think Tank. https://www.interface-eu.org/publications/ai-gender-gap

Luckin, R. (2018). Machine learning and human intelligence: The future of education for the 21st century. IOE Press.

Luckin, R., George, K. y Cukurova, M. (2022). AI for school teachers. Routledge.

Miao, F. y Cukurova, M. (2024). AI competency framework for teachers. UNESCO. https://doi.org/10.54675/ZJTE2084

MinCiencias. (2025). Mujeres Orquídeas 2025 lideran proyectos de inteligencia artificial y tecnologías cuánticas. Ministerio de Ciencias de Colombia.

Noble, S. U. (2018). Algorithms of oppression: How search engines reinforce racism. NYU Press.

OEI, Red INDICES y RICYT. (2026). Iberoamérica avanza hacia la igualdad científica. Organización de Estados Iberoamericanos.

Otis, N. G., Delecourt, S., Cranney, K. y Koning, R. (2025). Global evidence on gender gaps and generative AI. Harvard Business School Working Paper.

The hidden penalty of using AI at work. (2025). Harvard Business Review.

UNESCO e IRCAI. (2024). Challenging systematic prejudices: An investigation into bias against women and girls in large language models. UNESCO. https://unesdoc.unesco.org/ark:/48223/pf0000388971

UNESCO. (2019). I'd blush if I could: Closing gender divides in digital skills through education. UNESCO. https://doi.org/10.54675/RAPC9356

CC BY-NC-SA 4.0