De la ingeniería de instrucciones a la ingeniería de contexto: lo que cambia con los agentes de IA

Fernando Santamaría González IAforTeachers.com · Abril de 2026

El problema que nadie nombra

La mayoría de los docentes universitarios sigue usando la inteligencia artificial como un partido de ping pong. Pregunta, respuesta. Pregunta, respuesta. El profesor escribe, el modelo contesta, el profesor evalúa la respuesta, decide qué hacer y vuelve a escribir. Es el paradigma del chatbot, y durante tres años toda la formación del profesorado en IA se ha construido alrededor de una sola pregunta: ¿cómo formulo mejor mis instrucciones?

Esa pregunta ya no alcanza. Jensen Huang, CEO de NVIDIA, comparó recientemente los agentes de IA no con una aplicación ni con una herramienta, sino con un sistema operativo. La analogía es deliberada: así como Windows hizo posible la computación personal, los agentes están haciendo posible la automatización personal. No se trata de chatear mejor, sino de delegar objetivos completos a sistemas que planifican, ejecutan y entregan resultados sin supervisión constante.

¿Qué implica este salto para quienes formamos profesorado universitario? Que la competencia central ya no es redactar buenas instrucciones. Es diseñar buenos contextos.

Del chatbot al agente: anatomía de una diferencia

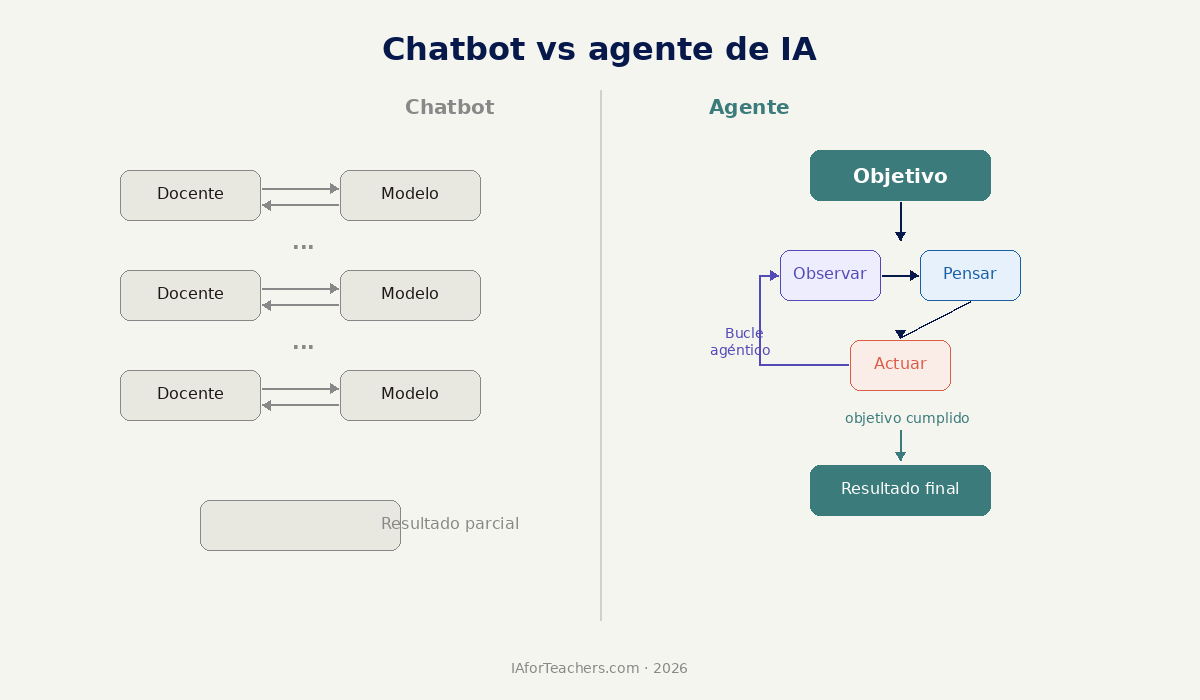

Cuando un docente usa ChatGPT, Claude o Gemini en modo conversacional, la dinámica es lineal. Cada intercambio es un evento aislado donde toda la información relevante debe proporcionarse explícitamente. El modelo no recuerda, no planifica, no verifica. Responde una vez y espera.

Un agente opera con otra lógica. Recibe un objetivo y entra en lo que se denomina bucle agéntico: observa qué información y herramientas tiene disponibles, piensa cuál es el siguiente paso y actúa ejecutándolo. Lo crucial es que no se detiene tras una acción. Vuelve al inicio, observa el resultado de lo que acaba de hacer, decide qué sigue y ejecuta de nuevo. Este ciclo se repite hasta que el objetivo se cumple.

La diferencia parece sutil pero es estructural. Un chatbot ejecuta una instrucción. Un agente persigue un objetivo. Y para perseguir objetivos de forma autónoma durante minutos u horas, el agente necesita mucho más que una instrucción bien redactada. Necesita un ecosistema informativo completo que le permita tomar decisiones coherentes en cada iteración del bucle.

Aquí es donde la ingeniería de instrucciones se queda corta y emerge la ingeniería de contexto.

¿Qué es exactamente la ingeniería de contexto?

En junio de 2025, Andrej Karpathy, cofundador de OpenAI, propuso una definición que se ha convertido en referencia del campo: la ingeniería de contexto es "el delicado arte y ciencia de llenar la ventana de contexto con exactamente la información correcta para el siguiente paso". Tres meses después, el equipo de ingeniería aplicada de Anthropic publicó una guía técnica donde formalizó esta idea: se trata del conjunto de estrategias para curar y mantener el conjunto óptimo de información durante la inferencia del modelo, incluyendo todo lo que llega más allá de las instrucciones.

La distinción con la ingeniería de instrucciones es directa. Mientras la ingeniería de instrucciones se centra en qué escribes al modelo (la formulación, la estructura, el tono de tu indicación), la ingeniería de contexto abarca todo lo que el modelo ve cuando procesa esa indicación: las instrucciones del sistema, las herramientas disponibles, los documentos recuperados, el historial de interacciones, la memoria persistente y los resultados de acciones previas. Tu instrucción sigue siendo la que dirige. Pero representa apenas una pieza del ecosistema completo.

Para dimensionar la asimetría: una instrucción típica ocupa 200 tokens. Una ventana de contexto actual puede albergar entre 100.000 y un millón de tokens. La instrucción representa, como mucho, el 0,2% de lo que el modelo procesa. Una instrucción brillante con mal contexto da resultados mediocres. Una instrucción sencilla con buen contexto da resultados que sorprenden.

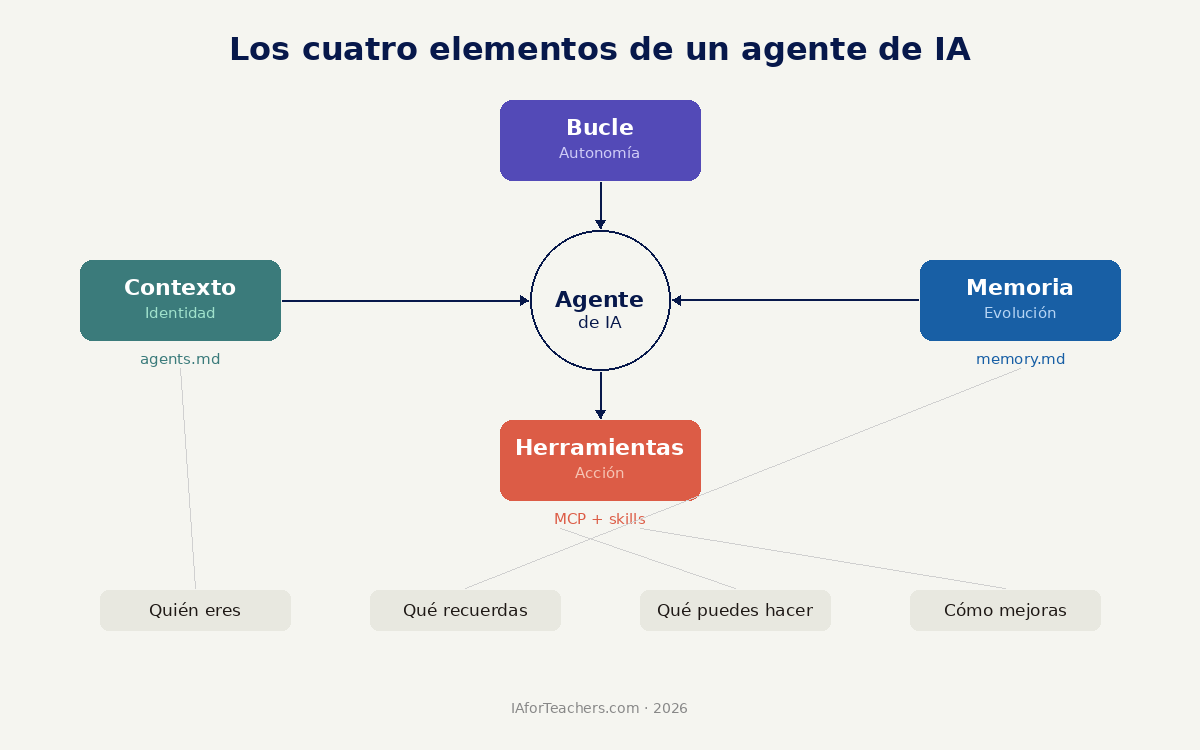

Los cuatro elementos de un agente

Más allá de la teoría, ¿qué componentes concretos necesita un agente para funcionar? Podemos identificar cuatro, y cada uno de ellos plantea un desafío de ingeniería de contexto distinto.

El bucle: la autonomía

Es el motor que convierte un chatbot en agente. Sin bucle, el modelo responde una vez y se detiene. Con bucle, persigue un objetivo iterativamente. Todos los agentes lo tienen, así que la diferencia entre un agente competente y uno mediocre no reside aquí, sino en los tres elementos siguientes.

El contexto: la identidad

En la práctica agéntica, el contexto se materializa en archivos concretos. Los desarrolladores trabajan con archivos como agents.md (o claude.md, gemini.md según la plataforma) que se cargan al inicio de cada sesión. Funcionan como las instrucciones que se entregan a un nuevo colaborador: qué hace la organización, cuál es su rol, qué criterios debe aplicar.

Pero el contexto va más allá de un solo archivo. Cuando la información es densa, por ejemplo, perfiles de estudiantes, rúbricas de evaluación, normativas institucionales, documentos de referencia, se organiza en carpetas estructuradas y el archivo principal simplemente indica al agente dónde buscar antes de cada tarea. Este es el corazón de la ingeniería de contexto: no se trata de meter más información, sino de arquitecturizar qué información está disponible, cómo se organiza y cuándo se consulta.

Anthropic lo resume con precisión: una buena ingeniería de contexto consiste en encontrar el conjunto más pequeño posible de tokens de alta señal que maximice la probabilidad del resultado deseado. Un estudio de Chroma Research (2025) que evaluó 18 modelos de lenguaje confirmó que el rendimiento se degrada a medida que crece el contexto, incluso en tareas simples. Más no es mejor. Mejor es mejor.

La memoria: la evolución

El contexto resuelve el problema de que el agente sepa quién eres. La memoria resuelve otro: que recuerde lo que ha aprendido. En la práctica, funciona mediante un archivo memory.md donde el agente registra correcciones, preferencias y aprendizajes que persisten entre sesiones.

Esto genera lo que podríamos llamar un bucle de automejora. El agente trabaja, comete un error, el usuario lo corrige, el agente guarda esa corrección y la próxima vez actúa mejor. Las preferencias se acumulan, las correcciones se sedimentan. Un agente con seis meses de memoria acumulada es exponencialmente más útil que uno en su primer día, no porque el modelo haya mejorado, sino porque su contexto personalizado se ha enriquecido progresivamente.

Para la docencia, este mecanismo tiene implicaciones considerables. Un agente con memoria podría recordar qué estrategias de retroalimentación funcionaron mejor con un grupo específico, qué aspectos de un tema resultaron confusos en sesiones anteriores o qué recursos bibliográficos ya se han recomendado. El contexto deja de ser algo que el docente reconstruye manualmente cada vez y se convierte en un ecosistema que evoluciona con la práctica pedagógica.

Las herramientas: la acción

Un agente sin herramientas puede pensar pero no actuar. Las herramientas le permiten buscar información, enviar correos, crear documentos, consultar calendarios o ejecutar código. Aquí es donde cobra relevancia el Model Context Protocol (MCP), un estándar creado por Anthropic que funciona como traductor universal: en lugar de desarrollar conexiones específicas para cada servicio, MCP proporciona un protocolo común de comunicación entre el agente y cualquier aplicación externa.

Junto a las herramientas genéricas aparecen los skills: procedimientos operativos digitales que el agente ejecuta de forma estandarizada. Un skill es, en esencia, la codificación de un proceso que se ha refinado una vez y se reutiliza indefinidamente. Si cada semana un docente convierte tres o cuatro procesos repetitivos en skills, como generar rúbricas, analizar entregas o redactar retroalimentación estandarizada, en pocos meses el agente gestiona una parte sustancial de su carga administrativa.

Cuatro disciplinas donde antes había una

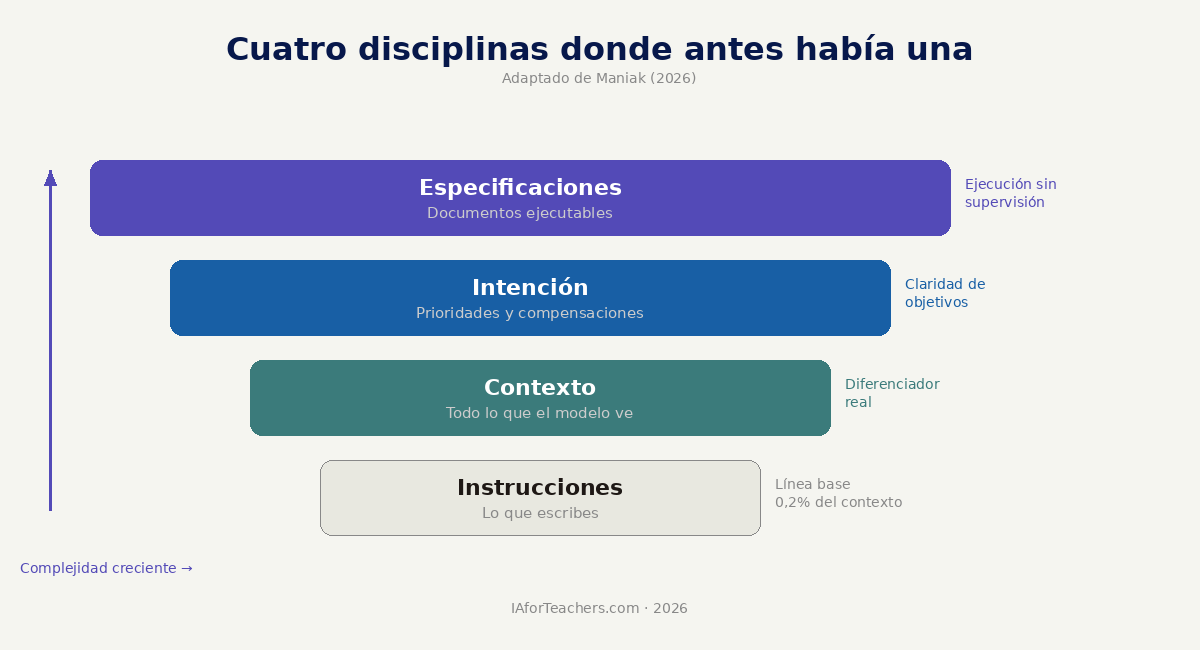

Sebastian Maniak propuso en febrero de 2026 una taxonomía que ilumina bien la amplitud del cambio. Lo que antes llamábamos "ingeniería de instrucciones" escondía en realidad cuatro competencias diferenciadas:

La elaboración de instrucciones sigue siendo necesaria, pero ya no diferencia. Es la línea base, no la ventaja.

La ingeniería de contexto diseña el entorno informativo completo: qué documentos recuperar, qué memoria preservar, qué herramientas definir, qué formato utilizar para cada dato. Quien obtiene resultados diez veces mejores con el mismo modelo no ha escrito mejor la indicación. Ha construido mejor infraestructura de contexto.

La ingeniería de intención explicita las compensaciones y prioridades antes de que el agente comience. "Mejorar mi curso" es una intención ambigua. ¿Reestructurar el programa? ¿Actualizar las lecturas? ¿Replantear la evaluación? La precisión en la intención determina la calidad de la ejecución autónoma.

La ingeniería de especificaciones se vuelve crítica cuando los agentes operan sin supervisión prolongada. Si no es posible corregir el rumbo en tiempo real, es necesario redactar especificaciones autocontenidas con criterios de aceptación verificables. Los programas de asignaturas, las guías docentes y los planes de estudio funcionan, de hecho, como especificaciones que tanto humanos como agentes pueden ejecutar.

Lo que esto significa para la formación docente

El docente como arquitecto de contexto

La transición redefine el perfil del docente que trabaja con IA. En la era de la ingeniería de instrucciones, la competencia era redaccional: formular bien las preguntas. En la era de la ingeniería de contexto, la competencia es arquitectónica: diseñar entornos informativos donde los agentes puedan operar con autonomía y coherencia.

¿Qué documentos debe consultar el agente antes de generar retroalimentación? ¿Qué criterios de evaluación necesita tener presentes? ¿Cómo gestionar la acumulación de información entre una tarea y la siguiente? Estas preguntas tienen una resonancia inequívocamente pedagógica. De hecho, la ingeniería de contexto está más cerca del diseño instruccional que de la informática.

El fin de las fórmulas mágicas

La cultura de las "instrucciones mágicas", esas plantillas universales que supuestamente garantizan resultados extraordinarios, pierde su fundamento. En lugar de enseñar a los docentes a "hablar bien con ChatGPT", necesitamos formarlos en el diseño de flujos de trabajo con IA donde se defina qué información está disponible en cada fase, cómo se gestiona la memoria del sistema, qué herramientas necesita el agente y cómo se verifican los resultados.

Los agentes como sistemas, no como herramientas

Quizá la idea más relevante para el profesorado sea esta: los agentes no son herramientas que se usan y se dejan. Son sistemas con bucles de retroalimentación que evolucionan con el uso. La diferencia entre un docente que "probó agentes y no le funcionaron" y uno que los tiene integrados en su práctica es, fundamentalmente, la paciencia de construir el sistema: definir el contexto, alimentar la memoria, conectar las herramientas y refinar progresivamente.

El valor no está en el día uno. Está en el mes seis. Y eso convierte al agente bien diseñado en un activo pedagógico que se revaloriza con cada interacción.

Una convergencia inesperada

La ingeniería de contexto, casi sin proponérselo, ha redescubierto un principio que la pedagogía defiende desde hace décadas: que el aprendizaje no depende de una buena explicación aislada, sino del diseño deliberado de todo el entorno donde esa explicación cobra sentido. Los recursos, las actividades, la secuenciación, la evaluación, la retroalimentación.

Las competencias que el profesorado universitario ya posee, las que aplica cada vez que planifica un curso, selecciona lecturas o construye una rúbrica, son precisamente las que esta nueva disciplina demanda. El contexto siempre ha sido el rey. La inteligencia artificial simplemente acaba de darse cuenta.

Referencias

Anthropic. (2025, 29 de septiembre). Effective context engineering for AI agents. Anthropic Engineering Blog. https://www.anthropic.com/engineering/effective-context-engineering-for-ai-agents

Anthropic. (2025, 29 de septiembre). Building agents with the Claude Agent SDK. Anthropic Engineering Blog. https://www.anthropic.com/engineering/building-agents-with-the-claude-agent-sdk

Chroma Research. (2025). Evaluación de rendimiento de modelos de lenguaje en contextos extensos [Estudio técnico].

Horthy, D. (2025). Advanced context engineering for coding agents. Presentación en Y Combinator Root Access. https://github.com/humanlayer/advanced-context-engineering-for-coding-agents

Karpathy, A. [@karpathy]. (2025, 25 de junio). +1 for "context engineering" over "prompt engineering" [Publicación]. X. https://x.com/karpathy/status/1937902205765607626

LangChain. (2025). Context engineering for agents. LangChain Blog. https://blog.langchain.com/context-engineering-for-agents/

Maniak, S. (2026, 27 de febrero). Prompting after Feb 2026: Prompt craft → context → intent → specs. https://maniak.io/articles/2026-02-27-prompting-post-feb-2026/

Mei, L., y otros (2026). Context engineering for AI agents in open-source software. arXiv. https://arxiv.org/abs/2510.21413

[Vídeo de referencia]. (2026). Agentes IA en 18 minutos. YouTube. https://www.youtube.com/watch?v=7HlfFHLoYK8

Este artículo forma parte de la línea editorial de IAforTeachers.com sobre competencias docentes para la integración de IA en educación superior, junto a documento más extenso y curso.