Delegación cognitiva en la docencia universitaria

¿Qué pierde el docente cuando la IA corrige por él? El espectro entre amplificación y sustitución del criterio pedagógico.

Entre la amplificación y la sustitución del criterio pedagógico

Un profesor corrige 120 trabajos con inteligencia artificial en una tarde. Antes le llevaba dos semanas. La tentación de celebrarlo es comprensible. Pero hay una pregunta incómoda que conviene hacerse antes de abrir el champán: ¿qué perdió por el camino? Jorge Rey Valzacchi y Silvana Perrotta exploran esta cuestión en su reciente libro Delegación cognitiva, y conviene detenerse en ella.

No nos referimos a la nostalgia del bolígrafo rojo ni al sufrimiento romántico de las noches de corrección. Hablamos de algo más concreto: el conocimiento diagnóstico que se obtiene al leer, con atención real, lo que un estudiante ha escrito. Ese conocimiento no se delega sin consecuencias.

La descarga cognitiva: de la calculadora a la IA generativa

El concepto de descarga cognitiva (cognitive offloading) tiene una trayectoria larga en la investigación psicológica. Risko y Gilbert (2016) lo definieron como el uso de ayudas externas para realizar tareas cognitivas. No es nuevo: usamos agendas para no memorizar citas, calculadoras para no operar mentalmente, correctores ortográficos para no revisar cada palabra. Hasta aquí, nada preocupante.

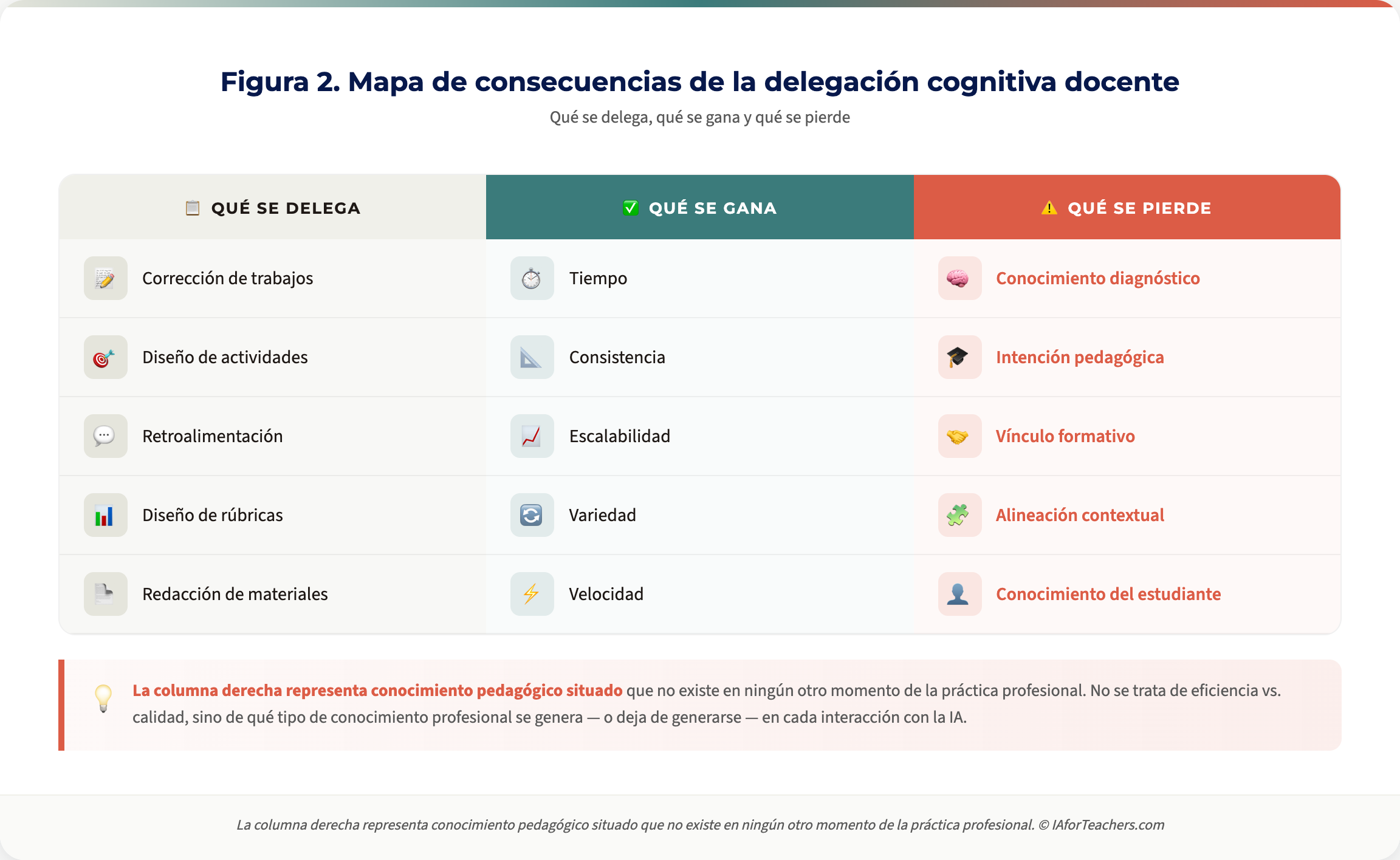

¿Qué cambia con la IA generativa? La escala y la profundidad de lo que puede delegarse. Ya no descargamos operaciones mecánicas, sino procesos que implican juicio, interpretación y síntesis. Un modelo de lenguaje puede generar retroalimentación personalizada, diseñar rúbricas, redactar objetivos de aprendizaje o evaluar la coherencia argumentativa de un ensayo. Todas estas son tareas que, cuando el docente las realiza, activan un conocimiento pedagógico situado que no existe en ningún otro momento de la práctica profesional.

La evidencia reciente es clara en este punto. Gerlich (2025) encontró una correlación negativa significativa entre el uso frecuente de herramientas de IA y las capacidades de pensamiento crítico, mediada precisamente por la descarga cognitiva. Kosmyna y colaboradores (2025), en un experimento con neuroimagen del MIT Media Lab, documentaron que los usuarios de modelos de lenguaje mostraban la conectividad cerebral más débil durante tareas de escritura, por debajo incluso de quienes usaban motores de búsqueda convencionales. La actividad cognitiva, concluyeron, se reducía en proporción directa al nivel de externalización.

Ahora bien, estos estudios se centran en estudiantes. ¿Qué ocurre cuando el que delega es el docente?

El ángulo que nadie estudia: la delegación cognitiva del profesorado

La mayor parte de la investigación sobre descarga cognitiva en educación observa al estudiante. Es comprensible: el riesgo de que los alumnos dejen de pensar porque la IA piensa por ellos resulta evidente y mediáticamente atractivo. Sin embargo, existe un territorio prácticamente inexplorado: la delegación cognitiva del propio docente.

Un profesor universitario escribe todos los días. Guías docentes, rúbricas, retroalimentación individualizada, informes de evaluación, materiales de clase, correos a estudiantes con dificultades. Escribe más que muchos escritores profesionales, aunque rara vez se piensa como tal. Cada uno de esos textos, cuando se elabora con intención, genera un subproducto invisible pero esencial: conocimiento diagnóstico sobre el estudiante, sobre la asignatura y sobre la propia práctica.

Cuando el docente delega la corrección a la IA sin leer las entregas, pierde el diagnóstico. Cuando delega el diseño de actividades, pierde la intención pedagógica que conecta la actividad con los objetivos de aprendizaje. Cuando delega la retroalimentación, pierde el vínculo formativo con el estudiante, ese momento en que la evaluación deja de ser un trámite y se convierte en una conversación sobre el aprendizaje.

No se trata de demonizar la eficiencia. Se trata de distinguir entre dos modos de uso radicalmente distintos que, desde fuera, pueden parecer idénticos.

El espectro de la delegación: de la amplificación a la sustitución

Proponemos pensar la delegación cognitiva como un espectro continuo entre dos polos. En un extremo, la amplificación: el docente utiliza la IA para potenciar su capacidad de análisis, generar borradores que luego revisa críticamente, contrastar su evaluación con la de la máquina o explorar formulaciones alternativas de una retroalimentación compleja. El criterio pedagógico permanece activo en todo momento.

En el otro extremo, la sustitución: el docente introduce los trabajos en la IA, acepta el resultado sin revisión sustantiva y lo envía al estudiante. El proceso se ha completado, pero el docente no ha leído realmente lo que el estudiante escribió. No sabe qué errores conceptuales persisten, qué conexiones inesperadas ha hecho, dónde se ha estancado.

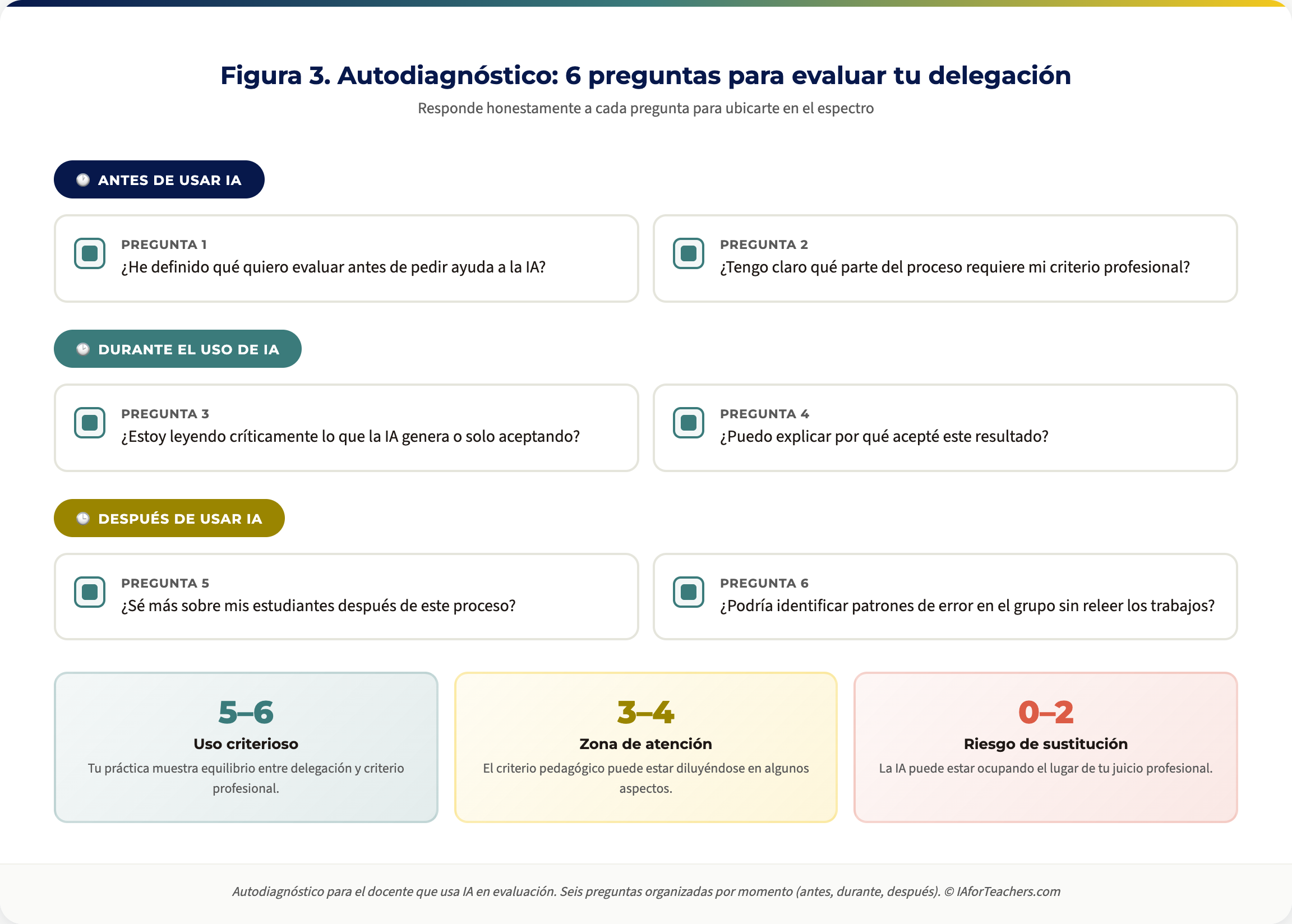

La paradoja es que ambos modos consumen tiempos similares en pantalla. La diferencia no es observable desde fuera. Solo el docente sabe, en cada interacción con la IA, si está pensando con la herramienta o dejando que la herramienta piense por él.

La evidencia que debería inquietarnos

Un estudio publicado en el British Journal of Educational Technology a finales de 2024 describió un fenómeno revelador: estudiantes que usaban ChatGPT para tareas de escritura mostraban lo que los investigadores denominaron «pereza metacognitiva», una tendencia a descargar en la IA los procesos cognitivos necesarios para sintetizar, analizar y argumentar. La herramienta se convertía en el centro de la actividad cognitiva, desplazando al propio pensamiento del estudiante.

¿Podría ocurrir algo análogo con el profesorado? La investigación específica es escasa, pero los indicios son consistentes. Una encuesta de NPR y Northeastern University en 2025 reveló que aproximadamente el 30 % del profesorado universitario usa IA generativa de forma semanal o diaria. Los propios docentes reconocieron que la calificación era la tarea en la que el chatbot resultaba menos eficaz. Y sin embargo, la usaban para eso.

«Estudiantes que usan IA para escribir trabajos y profesores que usan IA para corregirlos. Si eso es así, ¿cuál es el propósito de la educación?» — Marc Watkins, Universidad de Mississippi (en NPR, 2025)

No podemos responder a esa pregunta con datos concluyentes todavía. Pero la pregunta en sí misma ya señala un problema estructural que conviene abordar antes de que se normalice.

El criterio pedagógico como filtro de delegación

¿Significa todo esto que el docente no debería usar IA? En absoluto. La cuestión no es si se usa, sino qué se delega y con qué criterio. Proponemos una distinción operativa que puede servir como guía.

Hay tareas docentes donde la delegación es legítima y hasta deseable: formateo de documentos, generación de variantes de un ejercicio, transcripción de notas, búsqueda de referencias bibliográficas, traducción de materiales. Son tareas donde el valor añadido del docente es bajo y el coste temporal es alto.

Hay otras tareas donde la delegación exige supervisión activa: generación de rúbricas (que deben alinearse con objetivos específicos), diseño de actividades (que deben responder a una secuencia didáctica), redacción de instrucciones para estudiantes (que deben anticipar dudas y malentendidos). Aquí la IA puede proponer, pero el docente debe evaluar cada propuesta contra su conocimiento del contexto.

Y hay tareas donde la delegación implica pérdida directa: la lectura atenta de lo que el estudiante ha producido, la identificación de patrones de error en un grupo, la retroalimentación que reconoce el esfuerzo o señala un giro argumentativo prometedor. Estas tareas no son delegables sin vaciarse, porque su valor reside precisamente en que las realiza una persona que conoce al estudiante.

Pregunta diagnóstica: ¿Puedo explicar por qué acepté este resultado de la IA? Si la respuesta es «porque sonaba bien» o «porque no tenía tiempo», conviene detenerse.

Ni ludismo ni automatización ciega

El debate sobre la IA en la docencia universitaria se ha polarizado entre quienes la rechazan por principio y quienes la adoptan sin reservas. Ambas posiciones son cómodas. La posición incómoda, la que exige más trabajo intelectual, es la del uso criterioso: saber qué delegar, qué supervisar y qué reservar para el juicio humano.

Jordi Pérez Colomé, periodista tecnológico, ha reflexionado sobre los límites de la IA como escritora, señalando que la escritura profesional requiere algo que la máquina aún no resuelve. Es una conversación que apenas comienza.

Desde nuestra experiencia formando profesorado universitario, añadiríamos un matiz: el riesgo principal no es que la IA escriba mejor o peor que el docente. El riesgo es que el docente deje de leer lo que el estudiante escribe. Porque ahí, en esa lectura atenta e intencional, es donde reside buena parte de lo que hace que enseñar sea una profesión y no un procedimiento.

Referencias

Gerlich, M. (2025). AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking. Societies, 15(1), 1-28. https://doi.org/10.3390/soc15010006

Jose, J., Cherian, J., Verghis, A. M., Varghise, A. J., S, S. y Joseph, L. (2025). The cognitive paradox of AI in education: between enhancement and erosion. Frontiers in Psychology, 16, 1550621. https://doi.org/10.3389/fpsyg.2025.1550621

Kosmyna, N., Hauptmann, E., Yuan, Y. T., Situ, J., Liao, X. H., Beresnitzky, A. V., Braunstein, I. y Maes, P. (2025). Your brain on ChatGPT: Accumulation of cognitive debt when using an AI assistant for essay writing task. arXiv preprint arXiv:2506.08872. https://arxiv.org/abs/2506.08872

Rey Valzacchi, J. y Perrotta, S. (2026). Delegación cognitiva: el riesgo del sedentarismo mental en la era de la inteligencia artificial. Aprende Virtual. [PDF]

Risko, E. F. y Gilbert, S. J. (2016). Cognitive offloading. Trends in Cognitive Sciences, 20(9), 676-688. https://doi.org/10.1016/j.tics.2016.07.002